文|支付百科 張浩東 徐不醒

近年來,由于詐騙手段的升級變異用戶們早就習慣了時刻保持警惕,但令人想不到的是,有人面對面騙走對方數百萬資金,還能讓對方毫無察覺。

01 AI換臉“熟人局”

前幾日“10分鐘被AI換臉騙走430萬元”的事件還未熄火,近日又出現一起“AI換臉9秒騙走245萬元”的事件,將“AI換臉詐騙”推向了輿論的風口浪尖。

據了解,AI換臉詐騙主要通過“冒充熟人”讓受害人放松警惕,達到詐騙的目的,仿真度高、迷惑性強的特點增強了詐騙成功的可能性。

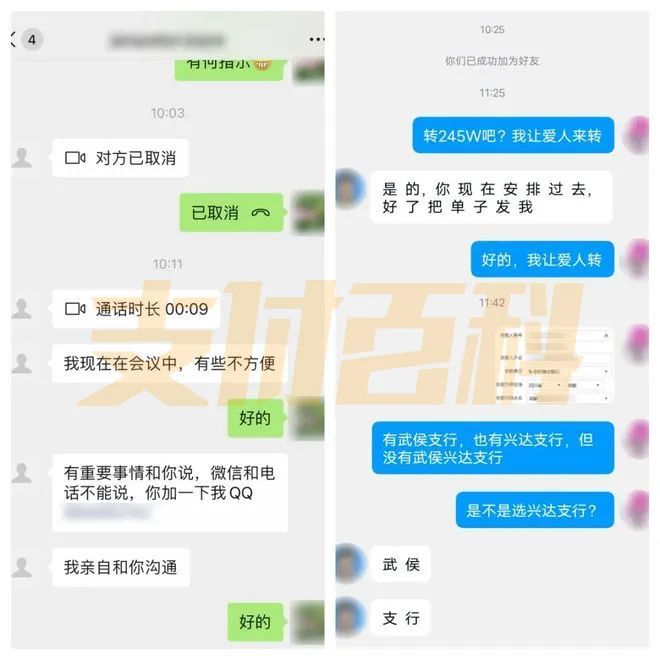

在“9秒騙走245萬元”事件中,受害人何某某表示,“視頻里邊我看到的是他的臉”、“但是沒幾秒就掛了,說不方便”。如圖:

隨后騙子稱自己在開會,微信和電話不能說,需要通過QQ進行溝通,由于對方已經證明是“好友”本人,何某某放松警惕,輕易就被帶入對方設好的圈套里,在對方向何某某表達有項目招標需要對方幫忙墊付資金時,何某某也毫不猶豫的轉賬。

何某某表示,“因為打了視頻電話又是熟人”、“我就沒多想,就轉賬了”。而前兩天10分鐘被騙走430萬元的受害人也是因為對方打了視頻電話是熟人的原因,輕易走進騙局。

實際上,何某某的案件在4月份就已經發生,4月末警方抓獲3名犯罪嫌疑人,前幾日將先行追回的132萬元被騙款返還給何某某,目前該案件還在進一步偵辦中。

而更為常見的其實是騙子利用熟人的聲音降低受害人的警惕,以急事為理由避免受害人有時間確認對方身份,迅速完成騙局。而AI 詐騙也提醒用戶,“眼見”不一定為實,一旦涉及借錢、轉賬等敏感字眼,一定要謹慎行事。

02 撕開AI假面

AI騙局猖獗,有關部門發布公告表示,“伴隨著深度合成技術的開放,深度合成產品和服務逐漸增多...”AI詐騙的違法行為已經屢見不鮮。

也有網友疑惑,對方是如何獲得好友的人臉、聲音信息的?

其實AI詐騙并非無的放矢的騙局,用戶在公開網站發布有關自己的視頻成了犯罪分子進行AI詐騙的重要素材,視頻內容越長、聲音越多越能合成更接近本人的AI人。有相關技術人員表示,目前了解到的AI換臉技術主要是采用Wav2Lip這種開源技術,通過音頻驅動口型。

對消費者來說,不論是盜取個人信息還是利用自己的身份進行詐騙,都是難以接受的,而AI詐騙輕易就能獲得個人信息的行為無疑在挑戰監管的底線。

在以往的電信詐騙案件中,犯罪集團大多都有專門獲取用戶個人隱私的渠道,而這些渠道的信息來自手機里各式各樣的APP,針對APP違規采集、泄露個人信息的情況,監管曾進行明確規范,一些不合規的APP將面臨整改、下架處理。在近期工信部通報的一批因侵犯個人隱私違規的APP中,除了一些游戲、美圖類APP,還不乏一些支付機構、銀行APP。

不過個人隱私泄漏不易察覺,用戶花心思識別AI詐騙手段也尤為重要。

相關人士認為,AI換臉并非100%相似,用戶可以在與對方視頻通話的過程中讓對方做一些大幅度動作,AI人說話時口型、面部表情可能會出現不同于常人的異常,而且在轉賬、資金來往的場景中,應當通過回撥電話、其他渠道聯系本人等多種方式核實對方信息,在確認無誤后再進行交易。