界面新聞記者 | 佘曉晨

近日,微軟開源DeepSpeed Chat的消息再次引發AI圈的關注。

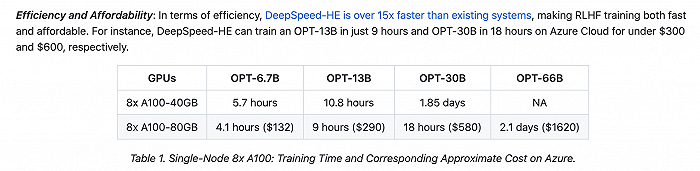

DeepSpeed Chat基于微軟的DeepSpeed深度學習優化庫開發而成,具備訓練、強化推理等功能,其使用了RLHF(基于人類反饋對語言模型進行強化學習)技術,可以將訓練速度提升15倍以上,同時大幅降低成本。根據微軟DeepSpeed組的官方介紹,DeepSpeed-Chat具有三大核心功能:簡化ChatGPT類型模型的訓練和強化推理體驗、DeepSpeed-RLHF模塊和DeepSpeed-RLHF系統。

在ChatGPT走向大眾視野之后,大模型背后的算力和訓練成本繼而成為焦點。

國金證券測算的數據顯示,在通用大模型訓練方面,使用云計算時ChatGPT的訓練成本約為170萬美元,若自建AI算力中心進行模型訓練,訓練成本有望降至約51萬美元;在大模型推理方面,使用云計算時的ChatGPT每處理1000Tokens信息需花費約0.177美分,自建AI算力中心有望將成本降至0.053美分。

今年3月1日,OpenAI宣布開放ChatGPT API接口,允許第三方開發者通過API將ChatGPT功能集成到自己的應用程序和服務中。該接口對每1000字符處理單元收費0.002美元,即支付兩美元可處理約75萬個英文單詞。OpenAI稱,新模型較GPT-3.5模型便宜10倍,成本下降主要因為團隊去年12月以來進行一系列的系統優化。

此前,開源社區已經推出過LLaMA、Alpaca、Vicuna、Databricks-Dolly等模型,讓更多人用上ChatGPT。不過,由于缺乏支持端到端的RLHF規模化系統,類ChatGPT模型的訓練依然存在不小的阻礙。

DeepSpeed方面表示,盡管開源社區付出了巨大的努力,但目前仍缺乏一個支持端到端的RLHF規模化系統,這使得訓練強大的類ChatGPT模型十分困難。

例如,用現有的系統訓練一個適度的6.7B ChatGPT模型,通常需要昂貴的多GPU設置,這是許多數據科學家無法做到的。即使有這樣的計算資源,訓練效率也往往低于這些機器所能達到的5%。即使有多GPU集群,現有的解決方案也無法做到簡單、快速和經濟實惠地訓練具有數千億個參數的最先進的ChatGPT模型。

為了讓ChatGPT這樣的模型更容易被普通數據科學家和研究者使用,并使RLHF訓練真正普及到AI社區,他們發布了DeepSpeed-Chat。

而在微軟開源DeepSpeed Chat之后,普通用戶可以通過簡單的操作訓練類ChatGPT等大語言模型。數據顯示,只需要花費1620美元,就可以通過混合引擎DeepSpeed-HE,在2.1天內訓練一個OPT-66B模型;如果使用多節點、多GPU系統,DeepSpeed-HE可以花320美元,在1.25小時內訓練一個OPT-13B模型,花費5120美元,在不到一天的時間內訓練一個OPT-175B模型。

這也是AI界為之振奮的原因。在微軟開源DeepSpeed Chat之后,更多人開始有機會直接上手訓練大模型。對于需要更多數據訓練的AI行業來說,也將是一次重要的節點。