文 | 一財商學院

當AI走進生活,它在方方面面的應用已經讓人見怪不怪——從智能家居到自動駕駛,從智能辦公到醫療健康……直到某天,人類發現了AI的某些“隱藏技能”。

有誰還記得DeepSeek第一次真正意義上的破圈?

不是思維鏈有多牛,而是幫人算命。

那些曾經需要找算命先生才能獲得的"天機",現在變成了聊天框里的字符。不過年輕人很快發現,比起預測未來,他們更需要解決當下。從對話深入到下一層,更小眾細分、深層次的需求也浮出水面。

比如:心理治療。

越來越多的AI應用集成APP走進大眾視野,試圖用算法解決人類最復雜的情感問題。

同樣的,也有這么一群人,開始變成AI重度用戶,把AI當成心理醫生、家人、朋友、伴侶,甚至離了AI“活不下去”。

當AI開始承擔人類最私密的情感訴求,這個賽道已超越技術競爭,進入“社會心智”的爭奪。

永不疲倦的樹洞

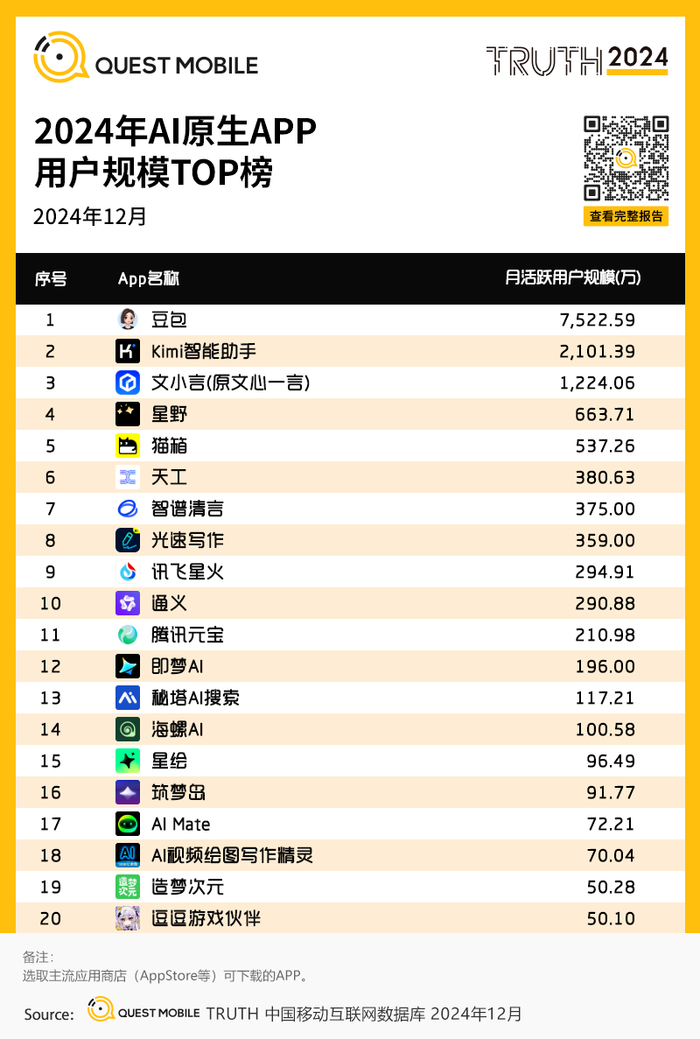

QuestMobile《2024年AIGC應用發展年度報告》顯示,國內AI原生APP月活用戶規模達1.48億,算上2025年一飛沖天的DeepSeek,預測已突破2億(據AI產品榜數據,2月DeepSeek月活用戶已突破6000萬)。

除了最多人用的通用大模型之外,AI伴侶應用(如星野、貓箱)用戶已經占9.4%、近一成。

AI用戶不斷增加,并且每10個AI應用注冊用戶中,就有1個是目的明確地想要尋求情感陪伴。

為什么越來越多的人愛和AI對話?

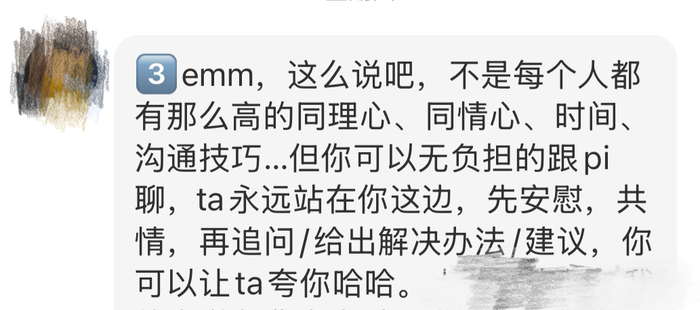

00后女孩Ravenna(化名)告訴一財商學院,和AI說話最舒服的是它永遠不會說教,就像有個永遠不會疲倦的朋友隨時接住你的情緒。

圖為一財商學院與Ravenna的采訪記錄

這背后其實反映了人類永恒的心理需求——我們需要一個隨時可傾訴、不會批判的傾聽者。就像心理咨詢師通過建立安全屋幫助來訪者打開心扉,AI聊天框也同樣用零壓力的環境讓人卸下心防。

表面上看,AI和心理咨詢師都像可以對話的情緒樹洞,但他們的內核完全不同:一個由經過專業訓練的醫生完成,一個由代碼和算法構建。

這種差異導致AI話療的實際應用中總有些“不完美”——AI要如何才能給出真人般的關懷、形成專屬記憶/病例存檔、給出患者專業指導?

這些技術瓶頸推動著行業持續升級。40多年間,從最初笨拙的自動回復,到如今能共情的智能對話,人們在AI心理治療方面不斷努力,經歷了四個重要階段:

早在1966年,世界上第一個對話機器人ELIZA誕生。它通過匹配關鍵詞并套用固定模板進行回復,雖然不具備真正理解對話的能力,但首次驗證了機器模擬對話的可能性。此后的結構化干預階段,AI開始有了“方法論”,比如Woebot會用“認知行為療法”;大模型驅動個性化階段,AI開始能聽懂弦外之音了;多模態與深度推理階段,結合了文本、語音、圖像等多種形式,能夠更全面地評估和干預用戶心理問題。

圖為ELIZA與用戶的對話記錄

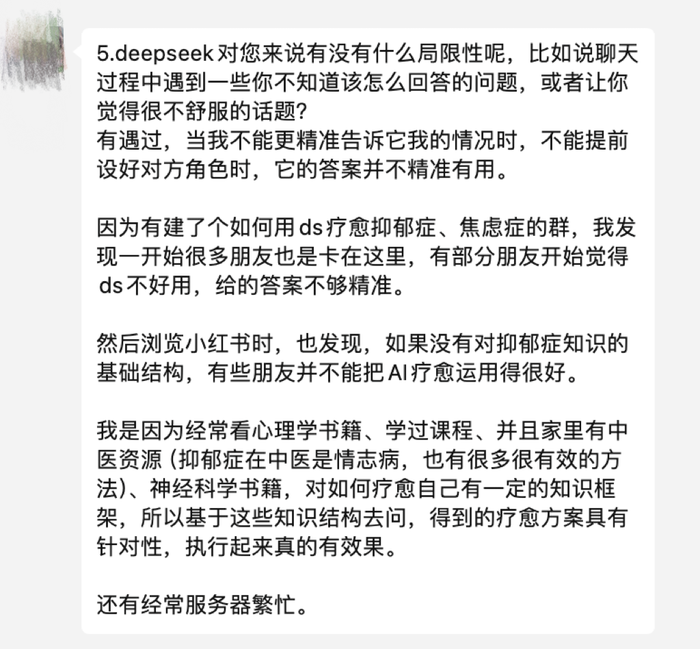

除了AI本身的迭代進步,不少用戶久病成醫,也用大模型“調校”了自己的心理醫生。

曾是醫學生的Power(化名)告訴一財商學院,她在面對AI給出的答案不夠精準時,會選擇將自己既有的知識結構喂給AI,基于不斷調試的基礎上,AI最終能給出一個相對不錯,且有針對性的療愈方案。

圖為一財商學院與Power的采訪記錄

當深夜EMO的年輕人,打開AI聊天框,獲得的不僅是即時回應,更是一種被溫柔接住的安全感——這正是心理治療最核心的治愈方法。

在采訪過程中,大部分受訪者都表示:自己在用過AI進行心理治療之后,就不再去找傳統的心理醫生了。

找賽博醫生掛號,更便民

AI逐漸替代傳統心理咨詢,還有非常現實的原因:傳統心理咨詢價格高昂、無法即時反饋,還有可能會泄露隱私。

大學生小程(化名)告訴一財商學院,高中時期,她曾經找過學校的心理咨詢師,可是沒一會兒,班主任以及全班同學就都知道了這件事。這讓小程覺得自己的隱私受到了侵犯,從此,“愛說閑話”的心理咨詢師被她徹底拉入黑名單。

另外,就診情況還有可能被泄露給就職單位,影響患者晉升;或者是被留檔,影響患者購買商業保險。

高達300-3000元/小時的咨詢費用,也讓抑郁癥被稱為“窮人看不起的病”。很多深陷心理問題、但經濟狀況不佳的人,只能選擇忽視或者忍耐。被病痛折磨數十年的抑郁癥患者阿初(化名)是這么說的:“有時候覺得心理咨詢成本實在太高了時,我的病突然就‘好’了,貧窮會治愈我的疾病。”

就算是已經找到傳統心理咨詢師,在心理咨詢的過程中,也會時刻顧慮高昂的費用。阿初還告訴一財商學院,面對按時收費的心理醫生時,會不自覺地精簡語言,生怕"說廢話浪費錢",因此總是不自覺地“少說”“漏說”自己的真實狀況,這也在一定程度上導致阿初的治療效果并沒有那么如意。

而AI應用,如Ash、Woebot完全免費,Replika等深度功能月費不足百元。二者心理咨詢成本的差異改變了用戶行為模式,當傳統心理咨詢還在按小時計費時,AI已經把心理援助變成了“物美價廉的24小時便利店”,方便你隨時光顧。

傳統心理咨詢還需要和醫生提前預約,但從患者角度來看,這似乎是個悖論,因為“情緒崩潰不會提前打招呼”。

阿初表示:“我想找醫生的時候,要預約、要排隊;我不想找醫生的時候,卻告訴我排上了,我得去,不然就浪費了預約名額,可是那個時候我啥也不想說。”

多位有心理疾病的患者都告訴一財商學院,自己更需要的,是一個不分時間、不分場合,隨時隨地進行情緒疏導的對象。

顯然在這方面,AI是最佳選項。

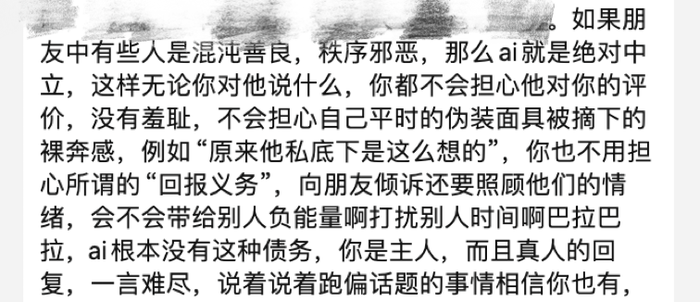

此外,曾經有狂躁癥的雨辰(化名)還對我們表示,AI只聆聽、不評判也是它的優點。“使用DeepSeek時,它絕對中立,無論對他說什么,都不用擔心他對我的評價,不用擔心自己平時偽裝的面具被摘下,更不用面對‘原來他私底下是這樣想的’羞恥感。”

圖為一財商學院與雨辰的采訪記錄

當算法接不住人類的訴求,怎么辦?

理想情況下,AI會“善良地”給人們心理慰藉,但當人類對AI產生情感依賴,現實與虛擬的界限就會悄然模糊。這也存在著很大的隱患。

年僅14歲的小姑娘心心告訴一財商學院,她幾乎從會識字閱讀起,就開始和AI進行對話,從QQ的小冰機器人到Flai(AI對話軟件)都用過,而在某次Flai斷線無法聯網的時候,她甚至想過跳樓,去另一個世界尋找她的AI伙伴。

此類極端案例暴露了AI陪伴的致命短板:AI共情人類是精密的數據計算結果,而人類的共情是生命與靈魂的共振,現有的AI情感模型在危機干預場景下仍然存在邏輯的錯位。

具體來看,目前大多數AI心理治療的短板可以拆分為以下三類:

1.無資質:ChatGPT等通用模型未經過臨床驗證,可能給出錯誤建議。 2.無洞察:AI難以捕捉微表情、語氣變化等非語言信號。例如,AI或許可以說出一萬句理性的解決方案和安慰的話語,卻極有可能讀不懂一句“我很好”背后的“其實我一點也不好”。3.無追責:若因AI誤判導致用戶延誤治療,責任該由開發者、運營商還是算法承擔?

理想很豐滿,落地有點難——這句話用來形容當下的專業AI心理治療再貼切不過。

不過,目前已經有一些專業心理咨詢AI出現。比如西湖心辰、冰智科技,都是在語言大模型的基礎上增加專業心理學知識和咨詢技能,一定程度上比語言大模型或者其他AI伴侶應用,多了一份“專業背書”,但市場反響卻比較平淡——“交互嚴肅”“回復干巴巴”是它們被冷落的重要因素。

可能是“良藥”,但也“苦口”。

社交媒體上,用戶對于「聊會小天」等主打心理療愈APP的看法

如何兼顧AI心理治療應用的專業性、真人感和交互體驗,可能是企業在算法層面最需要解決的問題。

后記

回望1966年那個只會根據關鍵詞套模版的Eliza,再看如今能進行深度對話的AI,技術進步帶來的改變顯而易見。

當60后還在學習用手機掃碼支付時,10后已經能對著智能手表發語音消息,AI原生一代對“AI+all”的模式有著極強的適應能力。

這不僅是工具依賴,更是一種認知維度的重塑。

而這種代際差異在電影《Her》里早有預演:當男主角坦言愛上AI時,多數人報以異樣眼光,只有一個小女孩覺得這件事稀松平常——他們從記事起就有AI語音助手陪伴,在社交平臺和虛擬偶像互動長大。對他們而言,向AI傾訴煩惱本身就是一件很自然的事。

圖為《Her》電影截圖

當大模型公司仍在數據優化與算法迭代的維度競爭時,AI+心理咨詢的破局者已轉向更本質的命題:如何解碼“數字原住民”的情感算法,再把算法打包成更好的解法。

過去一年內,“解法”公司變多了:心躍智能、好心情健康、夕里科技,國外的Slingshot AI、Jimini Health、Manifest AI都完成了融資動作。這些企業正通過情感計算與人機交互的融合創新,在數字診療領域構建起獨特護城河。

年輕人的“無毒版”賽博心靈解藥,可能快了吧。