文丨智駕時代 元霸

編輯丨浪浪山與明知山

2024年初始,智駕車企或明或暗開啟了一輪“城市NOA全國都能開”的激烈競賽。

頭部車企大多選擇了用“去圖”去應對全國都能開,年底前華為、小鵬、極越、理想等車企都基本擺脫了對“高精地圖”的依賴,部分或全量推送給用戶體驗相關去圖智駕版本。

“去圖”化(去高精地圖化)的背后是車端感知能力和AI端到端智駕技術帶來的云端大模型算法、算力和車端理解能力的增強。而更重要的是,隨著數據量的加大,端到端智駕系統對復雜路況的理解、分析能力正突破臨界點。

如果說,“去圖”是今年智駕比拼最重要的一條賽道,AI端到端同時帶來了另一條賽道的突破,也就是“去激光雷達”的視覺智駕正日益展示出應對復雜路況的成熟能力。

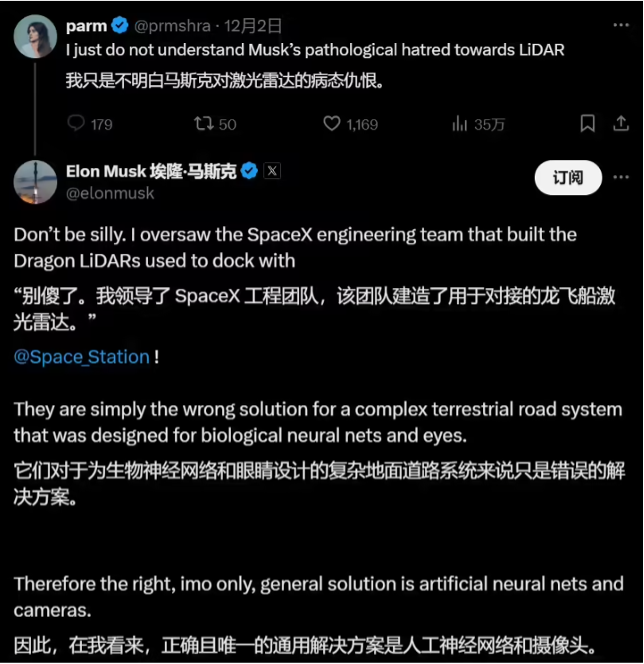

今天,馬斯克再次在社交媒體上表示激光雷達是錯誤的解決方案,并強調純視覺智駕就是復雜道路自動駕駛最有效的方案。

如果說馬斯克的話只能代表他的觀點,那么純視覺智駕在中國復雜道路上的表現,則更有發言權。

在近期的“中國智駕大賽”中,極越01和小鵬P7+作為唯二的純視覺車型,與華為系、蔚來、理想一眾激光雷達車型同場競技,表現也是可圈可點。

上周的分站賽,場地選在沒有高精地圖覆蓋的中山,考驗的是智駕系統“無圖全國都能開”的能力。

擁有AI端到端智駕的極越01作為比賽中唯一選用純視覺路線的車型,以小比分差距獲得季軍。

從榜單來看,極越01與前兩名小鵬G6(101.64)、理想L7 (101.41)的比分咬得很緊。此外,極越在13個分項中拿到了8個滿分。相比之下,總分第一的小鵬G6則獲得了6個滿分,而與搭載了鴻蒙智行系統的問界M7、阿維塔11、智界S7三款激光雷達車型相比,極越01也占有分數上的優勢。

綜合統計,純視覺的領軍極越01在10個城市的戰績是4個冠軍1個亞軍,1個季軍,成績名列前茅;小鵬P7+是僅在半個月參與了一站珠海站獲得了一個第四名,中山站未參賽。

既然極越的表現如此亮眼,是不是意味著純視覺智駕的春天來了呢?

智駕網認為,由于各家車企的技術路線不盡相同,純視覺智駕與雷視融合方案(依賴激光雷達的多傳感器融合方案)在較長一段時間內會同時存在。

但是,端到端純視覺智駕正展示出愈來愈強大的處理復雜場景的能力,同時在成本、技術穩定性與開發難度上全方位地超越雷視融合方案。

激光雷達做為一種感知冗余配置的地位更為明確,需要借助激光雷達處理的Corner Case的比例越來越少。

今年,隨著AI大模型的興起,不論是技術迭代、數據閉環、能力成長、用戶體驗等方面,純視覺都展示出了巨大優勢,甚至可以說,純視覺已經成為一個趨勢。

同時,純視覺路線的追隨者確實也越來越多,目前All IN視覺智駕的主機廠以特斯拉、極越、小鵬汽車為代表,而樂道L60、深藍S07、智界S7、新問界M5 等鴻蒙智行系車型也在2024年陸續加入了視覺智駕路線。

在國內汽車市場,極越汽車最早站隊純視覺路線,早在2023年初就開啟了相關布局,并在2023年10月極越01上市時量產了純視覺高階智駕。

從供應商的角度看,這一陣營則更為龐大,華為乾崑、百度阿波羅、卓馭(大疆車載)、大陸智駕、商湯絕影、智駕科技MAXIEYE、Nullmax都是視覺感知智駕技術的供應商,而百度阿波羅、商湯絕影、卓馭都認為視覺智駕就是最終路線。

激光雷達和高精地圖在業內曾被稱為智駕系統的兩大“支柱”,它們會在2024年底被行業拋棄,與馬斯克的判斷達成一致嗎?

我們先來梳理一下,純視覺智駕路線在即將過去的2024年經歷了怎樣的發展。 首先,視覺感知的水平在顯著提升。

在傳統認知里,攝像頭相比激光雷達應對陰暗、逆光、靜態物等場景的能力不足,在沙塵、雨雪等極端天氣下也有短板。

伴隨技術的發展,攝像頭能力的不足如今可以通過技術加持和新思路提升感知能力,并且即便視覺感知出錯,大模型也可以在短時間內進行修正。

比如:小鵬汽車的AI鷹眼視覺智駕方案引入了LOFIC架構大大提升了攝像頭的全場景感知能力。這項技術的誕生是為了滿足CMOS圖像傳感器對高動態范圍的需求。在逆光、大光差、暗光等環境下的信息采集能力更強。并且該架構方案的視覺感知范圍也更大,達到了1.8個標準足球場,甚至能夠清晰分辨顏色、文字等語義信息。

▲圖片來自:3d tof的《HDR技術詳細解析》

而作為國內號稱“特斯拉FSD平替”的極越ASD,則用大模型大幅提升了視覺算法能力。因為使用了短距“匕首”、中距離“手槍”、長距離“狙擊槍”等視覺大模型,極越ASD的視覺感知3D精度可達到厘米級,超越主流激光雷達。

據稱,ASD對運動障礙物速度的識別精度也控制在0.1米/秒誤差范圍內,大幅提升對于柵欄、護欄、水馬和施工隔離欄等有一定長度的通用障礙物的邊界識別能力,并通過減速、剎停或者繞行等動作完成避障,留出更多安全距離,繞障絲滑程度就像賽車手一樣“腦直覺”。

更重要的是,ASD不僅可以識別200米內礦泉水瓶,還能分辨綠植,預判行人的運動軌跡,即使在雨雪、霧霾或者在夜晚、隧道等光線不足的環境中,依然可以準確地感知和識別。

百度智駕負責人王亮曾表示,ASD使用的大模型與百度蘿卜快跑同源,即Apollo L4級自動駕駛的大模型Apollo ADFM(Autonomous Driving Foundation Model)。ADFM可以兼顧技術的安全性和泛化性,安全性數倍于人類駕駛員,而且覆蓋了幾乎全部復雜場景。

可以說,經過2023年的BEV+Transformer+OCC技術躍升,以及2024年大模型加持,視覺感知能力已經遠遠超越了激光雷達,同時擁有時間+空間的理解能力,在遇到復雜的Corner Case,大模型理解能力的提升甚至可以修正傳感器的錯誤。

大模型技術正在重構自動駕駛。

雖說兩種技術路線會并存,但激光雷達的缺點絕對不容忽視。

很多人都同意王亮的判斷,就是激光雷達做為精密儀器,移動部件會降低其可靠性,其能力可以被毫米波雷達和超聲波雷達分解替代,同時“偽影”問題會對系統造成巨大的干擾,消除“偽影“的處理復雜度極高。

此外,目前車載量產激光雷達的感知數據量依然太少,幾乎是攝像頭的160分之一。而且激光雷達點云數據還缺少色彩、紋理等關鍵信息,無法讓車輛用這些數據去推測環境意圖。

以下圖為例,左側的激光點云無法準確識別物體,而右側的攝像頭圖片可以準確分辨出紅色交通燈、斑馬線以及正在通行的行人和外賣車輛。

某智駕公司工程師曾向智駕網表示,視覺感知路線不僅省掉了激光雷達的成本,在決策效率上也要更快,因為省去了激光雷達感知信息的融合過程。

而從人類駕駛的形式來看,也不需要雷達來輔助,所以在技術上只要擁有了足夠強大的視覺感知能力,就可以實現高階智駕,級別甚至可以達到L4級。

這使得原本專注L4級別的Robotaxi行業,也開始押注純視覺方案。

10月11日,特斯拉發布的無人駕駛出租車Cybercab正是一款“不需要激光雷達做感知冗余”的L4級無人駕駛車輛。

盡管多家智駕科技公司曾向智駕網表示,視覺感知就是無人駕駛的終極解決方案,但激光雷達做為感知冗余配置在L4、L5級無人駕駛車輛上的配置在當前技術階段依然是不可取代的。

但馬斯克對于Robotaxi上能以純視覺方案實現完全自動駕駛的路線非常有信心:“使用AI和計算視覺,不需要昂貴的設備,就可以在無監督的情況下實現FSD。”

而商湯絕影CEO王曉剛向智駕網表示:“在短短的這幾年的時間里,自動駕駛軟件的架構、技術路線發生了幾次翻天覆地的變化。今天,這是一個行業發展趨勢,在視覺智駕這一趨勢到來的時候應該積極去擁抱新的變化。”

我們同意這種觀點,雖說兩種路線會有共存階段,但是純視覺智駕一定會成為下一個不可回避的必爭風口。