文|新眸 李小東

CoreWeave的大火被看作是AI云注定顛覆傳統云計算的一個開端。

從七年前的挖礦公司,長成一家AI云廠商,這被外界看來符合自身技術路線的轉型,加上與英偉達的曖昧關系,助推CoreWeave——一家規模不算龐大的公司,在短時間內估值達到190億美元,就在5個月前,它的估值才剛剛70億美元。

短時間內估值翻倍的背后,是全球 GPU 加速云基礎設施的爆炸性需求,以及當前的AI融資狂潮。和傳統云計算廠商賣計算資源、存儲空間和各種云服務不同,CoreWeave專注GPU云計算,特別是與AI領域的緊密聯系。

簡單來說,現在因為生成式AI(如聊天機器人、圖像生成等)越來越火,訓練和運行這些AI模型需要大量的計算能力。GPU(圖形處理器)因為能同時處理很多任務,成為了這類計算的優選硬件。

但事實上,買GPU和維護它并不便宜,所以很多人會選擇使用云計算服務。像亞馬遜AWS、谷歌云和微軟Azure這樣的主流公司都提供了特別為AI工作準備的GPU。但人們發現,有些專門提供GPU服務的小公司,比如CoreWeave,比那些大公司更便宜。

舉個例子,據媒體報道,在CoreWeave上租用一款流行的GPU,每小時不到2.4美元,但在AWS和谷歌云上都要花費3.5美元左右。換句話說,細微的價差和龐大的市場需求,正在將Gartner提到的“GPU即服務(GAAS)”這樣一個新的概念,日漸催化成了一個龐大的市場。

2024年,CoreWeave公司官方預測年度營收約24億美元,前兩年分別是3000萬和5億,雖然體量上和AWS這些巨頭相去甚遠,但夸張的增長態勢,已經不得不讓所有人對這個新興的行業側目。

01 顛覆傳統云廠商的鏟子從哪來?

CoreWeave之所以能被稱為算力黃牛,是因為此前靠挖礦積累了大量的GPU。

簡單來說,挖以太坊就像是一個巨大的數學競賽,礦工使用計算機(特別是像英偉達這樣的高性能GPU)來解一個叫“哈希函數”的難題。當他們用自己的GPU找到答案時,就贏得了一次挖礦的勝利,獎勵就是以太幣。

挖礦是一門技術活,更是體力活,為了獲得更多的以太幣,要挖更多的礦,與傳統的CPU相比,GPU具有更高的并行處理能力和更強的計算性能,能夠更快地執行復雜的加密算法。英偉達的GPU因卓越的性能和效率,成為了礦工們的首選鏟子。

CoreWeave的三名創始人Michael Intrator、Brian Venturo和Brannin McBee都是華爾街背景,關注金融和科技領域,五年的挖礦經歷,讓他們通過各種方式獲得了數萬張高性能顯卡,建立了不少數據中心。截至2018年末,CoreWeave部署超過5萬張GPU,并且在挖礦逐漸沒落的同時,借助算力資源轉型做起了云計算的生意。

將CoreWeave和英偉達推向高峰的chatgpt,更準確地說是預訓練大模型,因為訓練這些大模型的數據量極其龐大,過程可以被拆解成不同的小任務,這就非常適合GPU做。產量有限,一個成本約3000美元的H100顯卡可以賣到十倍價格。

據媒體報道,從宣布加入英偉達合作伙伴網絡計劃,到拿到首批英偉達HGX H100高性能計算平臺,再到掌握將英偉達 H100作為抵押品獲得融資,CoreWeave只用了不到三年。

之所以被英偉達青睞,外界普遍認為的核心是:在面對來自英特爾、AMD等半導體巨頭以及OpenAI、微軟等下游客戶自研芯片的壓力下,英偉達不得不既要抵御云廠商造芯片,又要進一步擴大GPU市場份額。所以芯片廠通過扶持不造芯片的CoreWeave、Lambda Labs等較小的云服務商,從而與微軟等巨頭能夠形成間接競爭。

按照這樣的邏輯,巨頭在尋求GPU資源時,如果只能通過CoreWeave等公司間接獲取,那么將需要支付更多的費用,包括購買GPU的費用以及使用CoreWeave等公司的服務費用。典型的例子就像剛與CoreWeave簽訂長期合作協議的微軟,這樣一來,作為最上游的英偉達仍然掌握最高的議價權。

CoreWeave依賴英偉達發財,就連它的創始人也坦然承認:“世界都在依賴英偉達,雖然我們也在了解不同的芯片和解決方案,但事實上,客戶明確表示,目前他們需要構建產品和AI芯片類型,很大程度上是由英偉達基礎設施推動的。”

但回過頭來,這些其實還不足以論證CoreWeave被市場看好的根本原因。

本質上,押注CoreWeave的英偉達、前蘋果高管、黑石等大量的資本,他們篤定另一個預判,傳統的云服務商將被更新興的AI云替代。

AI軟件的發展速度非常迅猛,開發的訓練過程需要更強大的計算資源,和更高效的云基礎設施來支持不斷增長,就連被定義為AI超大規模計算提供商的CoreWeave,有大量的GPU等設施,仍然供不應求。

就當前來看,現有的云基礎設施大多是為可序列化工作負載設計的,它們更適合處理那些可以分解成一系列獨立步驟并依次執行的任務;但AI工作負載的特性并不一樣:它們通常需要進行大量的并行計算,并且需要實時地處理大量的數據。

在CoreWeave的CTO看來,他們不僅擁有大量的GPU作為生產力工具,更重要的是其軟件技術非常先進,這是它能夠比其他公司更好地利用GPU服務器,確保客戶獲得最佳性能的原因。

02 更靈活、更劃算,CoreWeave能滿足什么?

為什么選擇CoreWeave,它的官網上有很直接地回答:

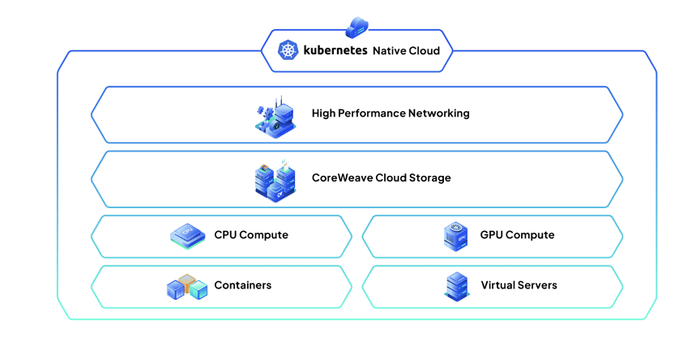

CoreWeave是一家專門為企業級GPU加速工作負載提供云服務商。他們的Kubernetes原生基礎設施專為機器學習、VFX渲染、像素流和批處理等計算密集型用例而構建,與傳統云廠商相比,速度最高可提高35倍,成本降低80%。

用創始人的Brannin的話簡單來說,CoreWeave的云不是簡單地加上GPU然后讓用戶能夠使用它。它其實是一個復雜的系統,像是一個大舞臺的導演,管理著所有的資源和設備,讓用戶可以方便地訪問和使用這些資源。

這和那些大公司的云不同,因為傳統云主要是為了托管網站和存儲數據,而CoreWeave是從頭開始打造的,專注于運行AI和其他需要大量并行計算的任務。這是它的核心優勢之一,對以前不能參與的決策,客戶有更自由,“嚴格的資源配額和等待數小時才能啟動GPU已經成為過去,現在你可以在幾秒鐘內調用、擴大和縮小數千個GPU。”

Brannin喜歡打一個比喻,CoreWeave和傳統云廠的區別,就像特斯拉和福特汽車。福特當然可以造出像特斯拉一樣的汽車,但這意味著他們需要經歷范式轉變,因為涉及的是整個供應鏈和整體業務,需要推翻過去重新開始,且容易陷入創新者困境,大公司往往不愿這么做。

當然,這種對AI的專一性,也直接造就了CoreWeave在給AI公司服務時的專業性。

CoreWeave的主要產品有7類,除了提供高性能計算平臺H100和最齊全的GPU,也提供CPU來滿足不同負載需求,還有完全托管的Kubernetes服務,消除了客戶管理Kubernetes集群的負擔,使他們能夠專注于應用程序的開發和部署;以及NVMe文件系統卷,這種高性能存儲適用于分布式機器學習訓練、VFX渲染、生命科學批處理和元宇宙像素流等工作負載。

除此以外,CoreWeave使用InfiniBand技術建立了高性能的網絡,相當于給每一輛車(GPU)搭建高速公路,能夠滿足大規模數據處理和傳輸的需求,從而有助于AI產品更快速地發展和規模化。

客觀來講,CoreWeave的產品體系覆蓋了高性能計算的各個方面,從硬件資源到軟件服務,讓模型訓練、托管、微調以及推理服務變得簡單。

至于具體的效果,對比A100,H100能將大型模型的AI訓練速度提高9倍,推理速度提高三十倍。H100的性能目前維持在行業第一,這種速度,加上NVIDIA Quantum-2InfiniBand平臺在市場上最低的網絡延遲,將AI模型的訓練時間縮短至幾天或幾小時,而不是幾個月。

以做NFT的Procedural Space為例,這是數萬個獨特的、程序生成的行星NFT的集合。每個行星都是使用獨特的算法生成的,這些算法控制著行星的顏色、地形構造、海洋、文明等,所有 Procedural Space 行星均制作為一分鐘的 4K 視頻,展示行星的完整旋轉。由于負載量大,幀速率為每秒30幀,因此需要1800萬個高分辨率幀。

以往他們用過其他的渲染引擎,但效果并不大好,但通過與CoreWeave合作,Procedural Space 能夠在短短一周內渲染、存儲、壓縮、編碼和制作100GB的4K高分辨率圖像,而成本僅為原來的六分之一。

那為什么說CoreWeave是當下AI公司最具性價比的選擇?

一方面,CoreWeave提供了業內價格最低、最廣泛的NVIDIA GPU系列選擇,客戶可以根據自己的工作負載選擇合適的GPU,從而確保性能和成本的最優化。并且與其他云提供商不同,CoreWeave 在絕大多數用例中不收取區域間傳輸、工作站數據或出口等費用,這樣客戶就不用擔心數據傳輸會花很多錢。

另一方面,CoreWeave提供了按需定價模式,意味著客戶只需支付他們實際使用的資源費用,無需簽訂長期合同或做出任何承諾。這種靈活性使得客戶能夠根據自己的實際需求進行擴展或縮減,從而節省成本。如果客戶需要長期或大量使用,他們還有折扣。這也就不難解釋,CoreWeave的云基礎設施的速度會比通用公共云快35倍,成本卻低了80%。

03 留給傳統云廠商的時間不多了

Brian Venturo作為CoreWeave的CTO,提到如果有一種新的芯片性能與英偉達相當或更好,那意味著市場上出現了一個強有力的競爭對手。

想象一下,如果你家附近新開了一家和沃爾瑪一樣大的超市,那么沃爾瑪的生意可能會受到一些影響,因為消費者現在有了更多的選擇。對于 CoreWeave 來說,這個新的芯片就像那家新開的超市,可能會吸引一些原本使用英偉達芯片的客戶。

但Brannin McBee 提到的一個觀點是,一種芯片的前兩到三年主要用于模型訓練,然后四到五年用于推理執行。這意味著即使有了新芯片,現有的英偉達芯片在一段時間內仍然會很有用,因為很多公司可能還在使用它們進行推理執行。

除此以外,英偉達不僅僅提供芯片,它還努力建立一個圍繞其硬件的開放生態系統。這意味著很多軟件、工具和服務都是與英偉達芯片緊密集成的。其他制造商雖然可以制造性能相近的芯片,但要建立一個像英偉達那樣的生態系統非常困難。

相比大型云廠商(如谷歌、微軟和AWS)需要投入大量的資金來建設和維護龐大的數據中心,還要提供一些低利潤的服務來吸引和保持客戶。CoreWeave這樣的公司,由于它們更專注于提供優質的AI服務,所以在基礎設施方面的投入相對較小,這使得它們更容易取得成功。

就像前面說的那樣,傳統云廠商是有“基礎設施包袱”的。

不過現實情況里,隨著谷歌、微軟和AWS等傳統云廠商開始加大對定制硬件的投資,CoreWeave也在經歷挑戰,這里的關鍵就在于,后者能否持續提供大量的GPU并保持價格上的競爭力。

對于一家AI公司的一個模型而言,退出訓練階段后,在產品上市的前兩年內,商業化階段的推理執行仍然至少需要百萬個GPU,但目前市場的供給遠不足夠,這將是一個長期的挑戰。換句話說,未來不排除越來越多像CoreWeave的公司出現,畢竟AI這股洪流的到來已經是個確定性的話題。