文|IT時報記者 郝俊慧

編輯|孫妍

北京時間6月3日晚9點30分,美股開盤,經過一個“漫長”的周末,全球都在等待一個答案:英偉達能否超過蘋果,成為全球市值第二的公司。

截至北京時間4日凌晨4點收盤,奇跡并沒發生,但兩者差距進一步縮小。英偉達當日上漲4.9%,市值為2.83萬億美元,一夜大漲1270億美元,折合人民幣約9000億元。蘋果則定格在194.03美元,市值為2.98萬億美元。

此前一天,英偉達創始人兼首席執行官黃仁勛在2024中國臺北國際電腦展上發表主題演講,并宣布最新產品Blackwell已經量產,并預計將于2025年推出增強版Blackwell Ultra GPU。

這不是全部。

“英偉達將每年更新一代產品。”會上,黃仁勛首次對外公布了預計2026年上市的下一代CPU“Vera”以及GPU“Rubin”,命名靈感來源于宇宙暗物質研究先驅、美國女天文學家Vera Rubin,這個速度打破了以18個月為周期的“摩爾定律”。當日,特斯拉CEO埃隆·馬斯克表示,旗下人工智能初創公司xAI將購買30萬塊英偉達B200 AI芯片。

長達近2個小時的演講中,“皮衣教主”展示了一個強大的英偉達NVIDIA 生態:芯片、系統、容器、網絡、平臺……基于GPU和CUDA,英偉達構建了強大的護城河——“AI工廠”。

72顆“芯”組成的超級GPU

距離GTC發布還不到3個月,Blackwell便已經量產。

黃仁勛手里拿著的GB200,被稱為“史上最強”GPU,由兩塊Blackwell GPU和一塊Grace CPU組成,兩塊芯片以每秒10TB的速度鏈接,采用臺積電4納米制程工藝,共有2080億個晶體管,其AI性能為每秒20千萬億次浮點運算。

2016年,英偉達推出新一代GPU架構Pascal,單芯片算力為19Tflops(每秒19萬億次浮點計算),并以此為基礎推出了第一代AI超級計算機DGX1,算力為170Tflops(每秒170萬億次浮點計算),黃仁勛將這臺機器交付給一家舊金山的初創公司OpenAI。

如今,八年過去,英偉達GPU芯片的計算能力、浮點運算以及人工智能浮點運算能力增長了1000倍,“這速度幾乎超越了摩爾定律在最佳時期的增長。”黃仁勛說道。

基于Blackwell的英偉達新一代系統DGX B200也被黃仁勛帶到了電腦展,這塊碩大主板上配備8塊GPU,每個DGX 系統提供144PFlops(每秒144千萬億次)的FP4浮點運算性能,1.4TB海量顯存和64TB/s顯存帶寬。黃仁勛透露,DGX B200采用傳統的風冷結構,支持x86系統,配備于已發貨的服務器中。

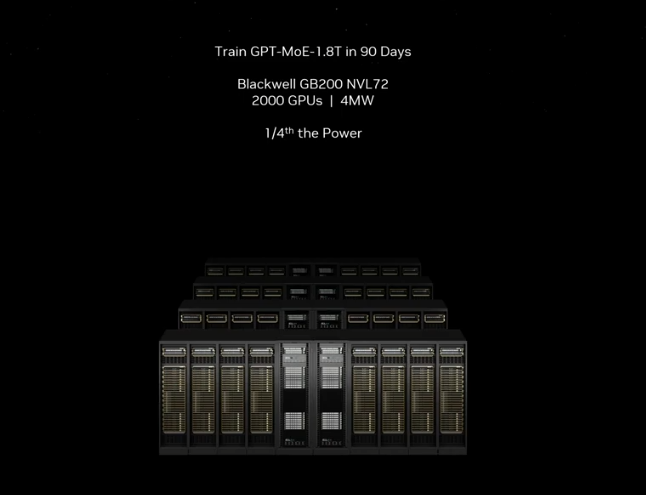

但這依然不是One more thing。基于DGX系統,英偉達設計了全新的液冷系統MGX,每個節點集成四塊GB 200超級芯片(8塊Blackwell),九個節點,總共72塊Blackwell通過NV-Link形成了一個“超級GPU”,背后的NV Link主干由5000條銅線組成,加起來長達3公里,其中的收發器可以驅動信號跑完整個線路。

Hopper時代(H100、H200時期)的DGX系統最多只能同時支持8塊GPU,而MGX使NVlink可驅動的GPU數量增加了8倍,帶寬增加了17倍。從功率上看,Blackwell的功耗略高于Hopper,9倍的GPU數量整體耗能是原先的10倍,但AI FLOPS(每秒浮點運算次數)提升了44倍,達1440PFlops,算力的“通貨膨脹率”相當于1:4.5。

越來越像“半導體界的蘋果”

“Buy more and save more(買得越多省得越多)”,黃仁勛一向擅長向CEO們兜售他的“CEO數學”。

不過,即便是對于財大氣粗的全球頂尖互聯網公司而言,Blackwell的價格也很“辣手”。

英偉達還未公布Blacwell的價格,但有匯豐銀行分析師認為,英偉達“入門級”B100 GPU 的平均銷售價格(ASP)將在 3 萬至 3.5 萬美元之間,與英偉達 H100 的價格相差無幾,而功能更強大的GB 200,價格可能在6萬至7萬美元之間。至于搭載Blackwell GPU的MGX服務器,單價預計高達 300 萬美元(約等于2174萬人民幣)。

“Blackwell正在滿負荷生產。”5月22日舉行的英偉達一季度財報業績說明會上,黃仁勛透露,Blackwell將在第二季度開始交付,三季度產能爬坡,四季度便能讓客戶建成基于Blackwell的數據中心。

在黃仁勛的設想中,英偉達交付的是一座AI工廠,構建了覆蓋整個數據中心的解決方案,一個綜合CPU、GPU、NVLink、NICK(特定技術組件)以及NVLink交換機等多個元素的完整系統,甚至可以說是為人工智能巨頭提供的“交鑰匙方案”,“為此,我們不遺余力地將所有技術推向極限,無論是臺積電的工藝技術、封裝技術、內存技術,還是光學技術。”黃仁勛表示。

這聽起來就是個“極致”昂貴的方案,可至少在目前,英偉達還沒有競爭對手。盡管最近各大巨頭都有自己的芯片規劃,谷歌、英特爾和高通成立了UXL基金會,專門用來開發一套支持多種AI加速器芯片的軟件和工具,以此對抗英偉達的CUDA生態。但黃仁勛明確的“一年一更新節奏”,使這種追趕還未出“起跑線”,便有被“超圈”的感覺。

在介紹產品細節時,黃仁勛明確指出,所有產品保持100%的架構兼容性,也就是說,Hopper可以平滑升級至Blackwell,而且所有軟件都具有向后兼容的慣性。也正因此,Blackwell平臺從問世到投產的時間,明顯快于此前的A系列和H系列。

黃仁勛一口氣宣布了三年升級計劃:2025年是Blackwell Ultra,2026年是新一代的Rubin,2027年是Rubin Ultra。

至少在兩年內,“尺度定律”(scaling law)在通用大模型迭代上仍有決定性作用,對英偉達而言,這是比算力增長“黃氏定律”還要深的護城河。

參數級越大的大模型訓練,越依賴于超大規模的GPU集群以及超高速的GPU連接。英偉達的新一代NVLINK交換機擁有500億個晶體管,74個端口,每個端口的數據速率高達400 GB,是72顆芯片變成1顆超級芯片的“幕后功臣”。

如果說NVLINK解決的是GPU和GPU之間的連接問題,那么將一個個AI服務器連接起來的網絡交換機也是必須的。以往,英偉達專注于InfiniBand交換機,一種高效但需要專用技術的設備,有一定應用門檻,但現在英偉達推出了面向以太網的交換機——Spectrum X800,可以每秒51.2 TB的速度和256路徑(radix)的支持能力,為成千上萬的GPU提供了高效的網絡連接。Spectrum同樣是一年一升級,預計兩年后發布的X 1600,是為更大規模的數據中心設計,能夠滿足數百萬個GPU的通信需求。

英偉達今年一季度財報顯示,與去年相比,不僅計算收入增長了5倍多,網絡收入也增長了3倍多。

英偉達還推出了一種推理微服務NIM,可以通過優化的容器形式提供模型——部署在云、數據中心或工作站上,開發者不再需要使用具有不同功能的多個模型來生成文本、圖像、視頻、語音等,只要使用NIM,便可以輕松地為copilots、聊天機器人等構建生成式 AI 應用,所需時間從數周縮短至幾分鐘。

無論是對軟硬件生態極致的追求,還是一年一升級的節奏,英偉達越來越像半導體界的蘋果。

AI的盡頭是電力

不過,再理想的未來,在能源問題面前,也可能會放緩腳步。

IEA 最近的《電力 2024》報告預測,到 2026 年,人工智能數據中心的電力需求將達到 90 太瓦時(TWh),這意味著,數據中心的關鍵IT電力容量要達到約10吉瓦(GW)功率,相當于730萬個H100的電力需求。

打造百萬塊GPU芯片超級集群的數據中心,并非不可能。黃仁勛在演講中放言,“隨著技術的不斷進步,數百萬個GPU的數據中心時代指日可待。”

“宏偉”目標背后暗含的判斷是,一方面,更大、更復雜的大模型需要被訓練,另一方面,未來的互聯網和計算機交互將越來越多地依賴于云端的生成式人工智能,而所謂云端背后,依然是超大規模的智算中心。

但電在哪里呢?不久前,AWS(亞馬遜云科技)剛剛以6.5億美元購買了一個 1000兆瓦的核能源數據中心園區,可分析機構SemiAnalysis認為,亞馬遜還有很多年才能實現整個電力供應能力。

SemiAnalysis曾測算,在利用率為80%且PUE為1.25的情況下,一個有20480個GPU集群的數據中心平均將從電網獲取 28~29MW 功率,每年總計能耗25萬兆瓦時左右。因此,數據中心、云服務商、大模型廠商必須考慮在現有電力供應條件下進行訓練。

來自供應鏈的估算,英偉達在2024年將出貨300 萬個以上GPU,對應超過 4200兆瓦時的數據中心需求,接近當前全球數據中心容量的10%,而這只是一年的 GPU 出貨量。

不難理解,為什么最近幾次演講中,黃仁勛反復強調英偉達GPU日趨下降的算力能耗比。

以Pascal為例,訓練GPT-4模型將消耗高達1000吉瓦時(1吉瓦時等于1000兆瓦)電能,放眼全球,暫時還沒有一個數據中心具有這么高的電力配備,這也是2020年前大模型為什么沒有出現的原因之一。

從時間上看,訓練一次GPT-4,使用Pascal大概需要一年;使用Hopper,可能需要三個月;換成Blackwell,10000顆芯片訓練同樣大小的模型,只需要3吉瓦時,耗時10天。

這是GPT-4模型首次公開訓練數據:2萬億參數和8萬億Token。參數量是GPT-3.5的11倍之多。

只是問題在于,業內普遍認為,GPT-4o,甚至GPT-5的參數級應該在數十萬億以上。因此,盡管黃仁勛表示,Blackwell使得生成每個Token只需消耗0.4焦耳的能量,可從絕對值上看,每臺DGX H100服務器的平均功率在11千瓦左右,每臺DGX B200耗能15千瓦,而MGX的功率是100千瓦。

事實上,大多數現有的數據中心尚未準備好支持每機架 20kW 以上的功率密度。一位數據中心人士曾告訴記者,原先能放10U的傳統服務器機架,現在只能放一臺智算服務器。

大批新型智算數據中心正在投建。SemiAnalysis的一份報告確認,OpenAI 計劃在其最大的多站點訓練集群中部署數十萬顆GPU,這需要數百兆瓦的關鍵IT電力供應。同時,有消息傳出,Meta的H100安裝量會達65萬顆。

“真正的電力短缺局面即將到來。”SemiAnalysis在報告中指出,全球數據中心關鍵IT電力需求將激增至2026年的96吉瓦,其中人工智能將消耗約40吉瓦。

AI的盡頭是電力,而英偉達的最終對手,可能也是它。

排版/ 季嘉穎