文 | Morketing Lumens

近日有外媒報道稱,由于人工智能“明星產品”ChatGPT的迅猛增長,OpenAI的年化收入已超過16億美元,而這距離CEO奧特曼在10月表示的13億美元年化收入僅僅只過去了兩個月。

如果從數字上的對比來看,OpenAI的年度收入增長更為驚人。其2022年的年收入僅為2800萬美元,甚至不及今年一周所帶來的收入。

更重要的是,隨著服務規模的擴大,OpenAI在首屆開發者大會上宣布了大降價的消息,這意味著進一步降低的價格將為OpenAI帶來更多的用戶和更大的發展空間。同時開發者大會還透露了更多關于GPT Store的消息,而這被許多人認為將成為大模型的“AppStore時刻”。

作為大模型賽道目前的領跑者,OpenAI的一舉一動都能成為整個AI賽道的引領和參考。因此,在OpenAI推出插件應用商店GPT Store之際對其盈利模式進行分析,我們或許能為國內外同類產品的商業化運作和未來發展提供一種可供參考的洞察維度。

OpenAI賺錢三大塊:用戶訂閱、開發者付費和微軟分成

自ChatGPT在2023年初爆火之后,隨著OpenAI不斷迭代產品,接連推出GPT-4、GPT-4 Turbo,其公司的商業模式也在迅速發展。經過2023年的探索和實踐,OpenAI目前的商業模式可以分為三個部分:

第一部分是面向廣大用戶,也是個人消費者最可能接觸到的會員訂閱服務。從2023年年初開始,OpenAI就推出了名為ChatGPT Plus的會員訂閱服務,用戶可以通過每月支付20美元來得到更快的響應服務,同時能夠優先使用功能更強大的GPT-4等模型。

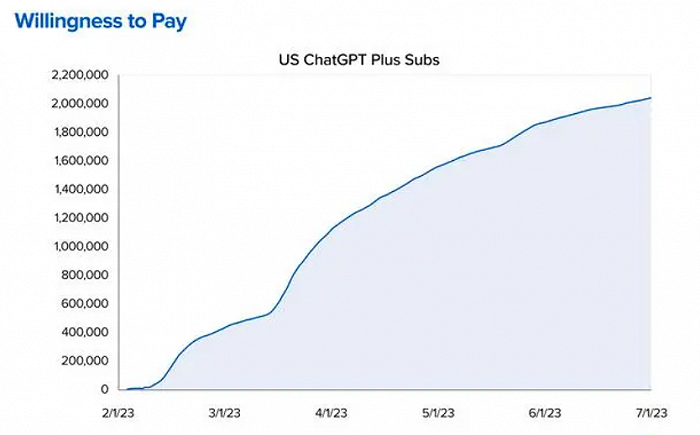

在付費用戶規模方面,OpenAI尚未披露過明確的數字。不過根據美國風投公司A16Z的數據,僅到去年7月份,ChatGPT Plus的付費用戶就達到200萬左右。再加上OpenAI在去年11月份曾一度因為使用者激增暫時關閉了新付費用戶的注冊,因此可以推測其付費用戶規模或許在百萬級別。

此外,即將在近期推出的GPT Store預計也會對會員訂閱服務產生更多影響。在去年11月份的首屆開發者大會上,CEO奧特曼表示GPT Store會收錄最受歡迎的GPT,同時進行創作者分成計劃,這意味著GPT商店的出現會刺激用戶數量和付費訂閱規模的進一步增加。

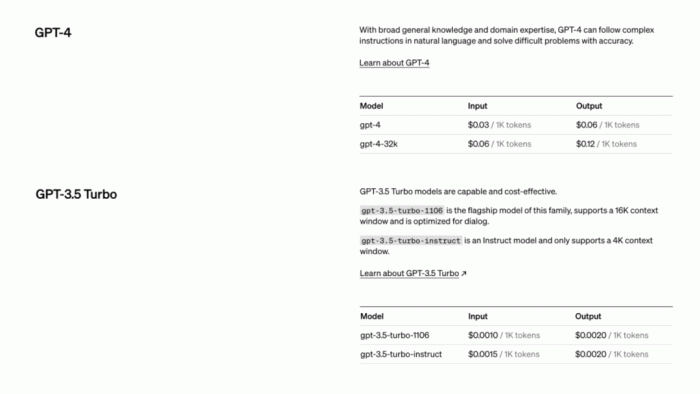

第二部分也是OpenAI最核心的收入,就是面向開發者的API接口調用收費模式。在這種模式下,開發者可以調用GPT系列大模型、DallE文字生成圖片模型和語音識別模型等功能,而需要根據流量計費向OpenAI付費。

同樣是在首屆開發者大會上,OpenAI對API接口調用收費模式也帶來了一場重磅升級,不僅帶來了更新的GPT-4 Turbo模型,還來了一場大減價。在這次會議上,CEO奧特曼表示GPT-4 Turbo在輸入方面成本是GPT-4的三分之一,而輸出方面的成本則降到了二分之一,大大降低了用戶的使用成本。

同時考慮到GPT-4 Turbo相比GPT-4的幾大升級,包括更長的上下文長度、更強的控制、模型的知識升級、多模態等。這種“加量又降價”的行為將吸引更多的開發者以及企業將GPT技術應用到其產品和服務中,進而成為OpenAI的客戶,逐步建立起圍繞OpenAI的全新商業生態。

OpenAI商業化的第三部分收入則是來源于與微軟的合作。在微軟豪擲數十億美元成為最大投資者之后,OpenAI和微軟旗下的各類產品都有著密切的合作。Azure作為當下全球最大的幾朵云之一,自去年年初和OpenAI共同推出了面向企業端客戶售賣的Azure OpenAI。客戶通過Azure云大模型的每一筆付費,OpenAI都可以獲得相應的分成。

據了解,宜家、沃爾沃和可口可樂等公司都在通過微軟的Azure云獲得OpenAI的接口服務。這意味著,憑借著微軟和眾多大型企業的合作關系,OpenAI可以較為輕松地獲得這些大企業的合作業務以及收入分成。

值得一提的是,OpenAI在上述商業化方面的成功遠遠超出了管理層的預期,公司的營收預期在2023年經歷了數次上調。在去年早些時候,CEO奧特曼認為OpenAI在2023年的收入僅為2億美元左右,而在9月這一數字增加到10億,隨后又上升到了13億,如今的16億美元年收入對比最開始的2億預期早已翻了三番。

從這種增長速度來看,再加上OpenAI對接口服務的“大減價”,GPT的用戶數量和覆蓋范圍很有可能會在2024年再上一個臺階。也正是由于這些原因,目前在產品技術和商業化都處于優勢的OpenAI已經給出了2024年年化收入達到50億美元的新目標。

硬件、運營、人力成本“三高”,員工薪酬超2億

不過就在年化收入坐火箭般增長的同時,OpenAI作為處于人工智能前沿的科技公司,其科研投入和開支同樣不菲,堪稱一個“吞金獸”。

從OpenAI的商業運營模式來看,為了支撐其大模型產品的競爭力,OpenAI的開支主要分為三個部分:

一是開發大模型期間的硬件投入和訓練成本。大模型作為計算機科學的前沿成果,自然和計算機、芯片等算力硬件離不開關系,微軟向OpenAI投資的10億美元以及后續追加的一百多億美元就是在AI超級計算機和芯片上花了大頭。據微軟高管透露,為了提供足夠的算力,搭建起的超級計算機配備了數萬個英偉達A100GPU,并在60多個數據中心總共部署了幾十萬個英偉達GPU輔助。

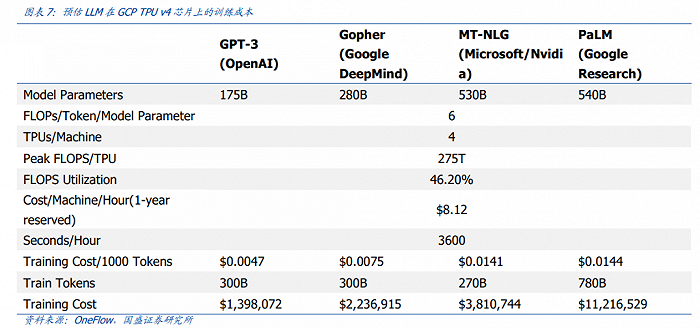

除了硬件費用外,大模型在開發期間的訓練成本也是非常之高。根據國盛證券發表在去年2月的報告《Chatgpt 需要多少算力》估算,GPT-3訓練一次的成本約為140萬美元,對于更大的LLM模型,訓練成本介于200萬美元至1200萬美元之間。需要指出的是,這里提到的是GPT-3的單次訓練成本,后面推出的GPT-3.5、GPT-4等數據量更多的模型,其訓練成本也只會更多不會更少。

二是日常運維成本。國外媒體Analytics India Magazine在去年曾對OpenAI的日常運行成本做出估算,它推測稱OpenAI為了保持ChatGPT的正常運行就需要每日耗費約70萬美元成本。而且在GPT大火之后,訪問量的暴增也會直接導致日常運行成本的成倍上漲。

三是高昂的人力成本。IT行業作為智力密集型行業,工程師的平均薪酬本就相對較高,在OpenAI所在地舊金山就更是如此。之前有報道稱,由于OpenAI的員工中有許多機器學習領域的大佬,在公司僅有300多名員工的情況下,整個公司的薪資成本在2億美元以上。

而隨著谷歌、Meta等巨頭也在大模型賽道努力追趕,為了防止員工的流失,OpenAI勢必要再次提高薪酬待遇來將員工留下來。

此外,需要注意的是,上面所提到的OpenAI各種收支情況基本上都處于AIGC商業化的第一個階段即嘗鮮階段。在《AIGC未來已來 邁向通用人工智能時代》這本書中,作者將AIGC的商業化分為了三個階段,分別是:感知沖擊-嘗鮮階段、認知領悟-協助階段、新生態鏈-原創階段。

從目前主流的聊天機器人以及文字生成圖片、視頻等多媒體產品來看,現在的AIGC尚處于通過圖片和視頻等形式滿足用戶嘗鮮需求的第一階段。大多數人追捧AI的原因只是因為這是從未出現過的新事物,需要從使用體驗上滿足好奇心。

而如何讓AIGC超越簡單的輔助,成為虛實融合的重要載體,乃至更進一步地完成獨立創作、原創內容等任務就成了OpenAI等公司的未來目標。畢竟當用戶們對AIGC越來越熟悉,失去嘗鮮的動力之后,用戶和企業自然而然地會對人工智能的生產力方面提出更高的要求,如果屆時OpenAI拿不出令人滿意的產品升級,用戶的付費意愿想必會大打折扣。

OpenAI的16億美元年收入賣的是什么?

當我們分析OpenAI年收入目標從2億美元到16億美元的飛躍時,與其說OpenAI賣的是產品,不如說他們更多的是在兜售人們對于人工智能技術的嘗鮮體驗和未來暢想。

但是在嘗鮮過后,這些新技術只要在更多的實踐中體現出價值,才能從科技噱頭走向與實踐結合的商業化新階段。不然只會像機器人領域的波士頓動力公司一樣,雖然其產品性能表現處于世界前列,但由于在現實中沒有太多應用場景,其公司幾乎一直在虧損和被出售中徘徊。

而經過2023年一整年的熱鬧之后,生成式AI行業其實是存在著未來會“變冷”以及會持續熱潮這兩種聲音。

認為會持續熱潮的觀點自然不必多說,而認為會變冷的觀點主要集中在各國對AI限制法案的出臺、AI模型訓練內容侵權引起的爭議,以及許多公司由于AI工具帶來的好處無法覆蓋其成本和風險,這部分客戶會從AI領域中撤出。整個行業也將經歷一輪整合,淘汰一部分參與者。當然這里說的變冷只是相比于2023年的火熱而言,AI行業的“變冷”更像是往正常發展區間的一次回調。

雖然目前的硅谷巨頭們都非常看好AI的發展,但在人工智能發展史上,已經有過三次“AI寒冬”,再宏大的技術愿景也會有因各種現實限制化為泡影的可能。而把這個道理放到OpenAI身上就意味著,ChatGPT想要在未來繼續大火,必須要有在新鮮感之外明確證明自己價值的能力。