文|巴比特資訊

AI 驅動的圖像生成正在蓬勃發展,這是有充分理由的:它有趣且易于使用。雖然這些模型帶來了新的創意可能性,但它們可能會引起人們對不良行為者潛在濫用的擔憂,這些不良行為者可能會故意生成圖像來欺騙人們。即使是為了好玩而創作的圖像也可能會像病毒一樣傳播并可能誤導人們。

例如,今年早些時候,教皇方濟各穿著一件華麗的白色蓬松夾克的圖片在網上瘋傳,特朗普被逮捕的照片引發熱議。這些圖像不是真實的照片,但很多人都被愚弄了,因為沒有任何明確的指標來區分這些內容是由生成式 AI 創建的。

Meta 研究人員近日發布了一篇新的研究論文和技術代碼,詳細介紹了一種為 AI 圖片添加隱形水印的技術,用于區分開源生成式 AI 模型何時創建的圖像。隱形水印將信息合并到數字內容中。這些水印肉眼看不見,但可以通過算法檢測到——即使人們重新編輯了圖像。雖然圍繞水印還有其他研究方向,但許多現有方法在生成 AI 圖像后創建水印。

據 Everypixel Journal 報道,用戶已經使用三個開源存儲庫的模型創建了超過 110 億張圖像。在這種情況下,只需刪除生成水印的行即可刪除不可見水印。Stable Signature 提出了一種方法來避免水印被刪除。

01、Stable Signature 方法的工作原理

論文地址:

https://arxiv.org/abs/2303.15435

Github 地址:

https://github.com/facebookresearch/stable_signature

Stable Signature 通過將水印扎根于模型中,并使用可追溯到圖像創建位置的水印,消除了刪除水印的可能性。

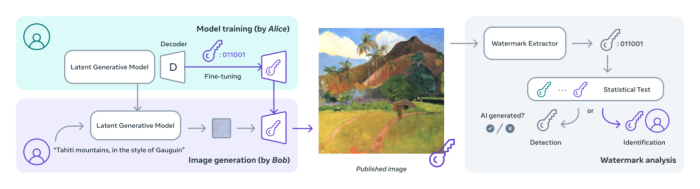

讓我們通過下面的圖表來看看這個過程是如何工作的。

Alice 訓練了一個主生成模型。在分發之前,她對模型的一小部分(稱為解碼器)進行了微調,從而為 Bob 生成給定的水印。該水印可以標識型號版本、公司、用戶等。

Bob 收到他的模型版本并生成圖像。生成的圖像將帶有 Bob 的水印。Alice 或第三方可以對它們進行分析,看看圖像是否是由使用生成式 AI 模型的 Bob 生成的。

這通過兩步來實現:

1. 聯合訓練兩個卷積神經網絡。一種將圖像和隨機消息編碼為水印圖像,另一種則從水印圖像的增強版本中提取消息。目標是使編碼和提取的消息匹配。訓練后,只保留水印提取器。

2. 對生成模型的潛在解碼器進行微調以生成包含固定簽名的圖像。在此微調過程中,會對批量圖像進行編碼、解碼和優化,以最大限度地減少提取的消息與目標消息之間的差異,并保持感知圖像質量。這種優化過程快速有效,只需要小批量和很短的時間即可獲得高質量的結果。

02、評估 Stable Signature 的性能

我們知道人們喜歡分享和轉發圖像。如果 Bob 與 10 個朋友分享了他創建的圖像,然后每個朋友又與另外 10 個朋友分享了該圖像,結果會怎樣?在此期間,有人可能會更改圖像,例如裁剪、壓縮或更改顏色。研究人員構建了Stable Signature以應對這些變化。無論人們如何轉換圖像,原始水印都可能保留在數字數據中,并且可以追溯到創建它的生成模型。

研究人員發現 Stable Signature 相對于被動檢測方法的兩大優勢:

首先,能夠控制和減少誤報的產生,當將人類生成的圖像誤認為是 AI 生成的圖像時,就會發生誤報。考慮到在線共享的非 AI 生成圖像的盛行,這一點至關重要。例如,最有效的現有檢測方法可以發現大約 50% 的編輯生成圖像,但仍會產生大約 1/100 的誤報率。換句話說,在每天接收 10 億張圖像的用戶生成內容平臺上,大約 1000 萬張圖像將被錯誤標記,從而僅檢測到一半的 AI 生成圖像。

另一方面,Stable Signature 以 1e-10 的誤報率(可以設置為特定的期望值)以相同的精度檢測圖像。此外,這種水印方法允許追蹤同一模型的不同版本的圖像——這是被動技術無法實現的能力。

03、如果一個大模型經過了微調,Stable Signature 如何檢測到微調版本生成的圖像?

AI 大模型的一種常見做法是采用基礎模型并對其進行微調,以處理有時甚至為一個人量身定制的特定用例。例如,可以向模型顯示 Alice 的狗的圖像,然后 Alice 可以要求模型生成她的狗在海灘的圖像。這是通過 DreamBooth、Textual Inversion 和 ControlNet 等方法完成的。這些方法作用于潛在模型級別,并且不會更改解碼器。這意味著我們的水印方法不受這些微調的影響。

總體而言,Stable Signature 與矢量量化圖像建模(如 VQGAN)和潛在擴散模型(如 Stable Diffusion)配合良好。由于這種方法不修改擴散生成過程,因此它與上述流行模型兼容。通過一些調整,穩定簽名也可以應用于其他建模方法。

04、AI 水印真的靠譜嗎?

通過添加隱形水印的方式來識別 AI 生成圖像的技術最近受到很多爭議。Google DeepMind 最近宣布針對圖像生成推出一種添加水印的工具 SynthID,同時識別 AI 生成的圖像。通過掃描圖像中的數字水印,SynthID 可以評估圖像是由 Imagen 模型生成的可能性。

但 AI 水印是否能夠被輕易去除?據外媒 Engadget、Wired 等報道,美國馬里蘭大學的一個研究小組對 AI 生成內容的“數字水印”技術可靠性進行研究,發現這一技術可被輕易破解。

該校計算機科學教授 Soheil Feizi 面對 AI 生成圖像的水印現狀時直言不諱:“目前我們沒有任何可靠的水印技術,我們破解了所有的水印。”

在測試過程中,研究人員可輕松避開現有的水印方法,并發現在非 AI 生成的圖像上添加“假水印”更為容易。同時,該團隊還開發出了一種“幾乎無法”從圖像中去除的水印技術,且不會完全損害圖像的知識產權。

AI 水印這種方式仍舊不過成熟,并不能成為百分百有效的工具。我們需要期待未來能夠出現新的技術來為生成式 AI 圖像保駕護航,避免虛假圖片泛濫,避免版權侵害。

參考資料:

https://ai.meta.com/blog/stable-signature-watermarking-generative-ai/